GPU 인스턴스

Oracle Cloud Infrastructure(OCI) Compute는 메인스트림 그래픽, AI 추론, AI 훈련, 디지털 트윈 및 HPC를 위한 NVIDIA 및 AMD GPU 기반의 베어메탈과 가상 머신(VM) 인스턴스에 업계 최고 수준 확장성과 성능을 제공합니다.

OCI 관련 최신 발표 읽어보기

-

NVIDIA Blackwell

NVIDIA DGX Cloud와 OCI에 NVIDIA GB200 NVL72 시스템이 도입됩니다. 자세히 알아보세요.

-

Oracle과 AMD의 협업

Oracle과 AMD는 OCI에서 AMD Instinct MI355X GPU를 사용해 대규모 AI 학습 및 추론 워크로드를 실행할 수 있을 것이라고 발표했습니다.

-

Seekr, 신뢰할 수 있는 AI를 위해 OCI 선택

Seekr는 엔터프라이즈 AI 배포, 다중 노드 AI 훈련, 에이전틱 AI를 가속화하기 위해 OCI AI 인프라를 선택했습니다.

-

제1원칙, 제타스케일 슈퍼클러스터

OCI의 클러스터 네트워크가 확장 가능한 생성형 AI를 어떻게 지원하는지 확인해 보세요.

-

소버린 AI

Oracle과 NVIDIA는 어디서나 소버린 AI를 제공합니다.

-

NVIDIA GPU 장치 플러그인용 GA

OCI Kubernetes Engine의 플러그인이 더 강력한 제어와 유연성을 제공합니다.

-

OCI AI Blueprints

운영 환경에서 AI 워크로드를 손쉽게 배포하고 확장할 수 있습니다.

-

AMD Instinct MI300X GPU

AMD GPU가 탑재된 OCI 컴퓨트 베어메탈 인스턴스가 상용 출시되었습니다.

6월 11일, OCI와 NVIDIA RTX PRO로 운영 환경의 AI를 지원하는 방법을 확인해 보세요.

GPU 인스턴스에 OCI를 사용해야 하는 이유

확장성

131,072

OCI Supercluster의 최대 GPU 수1

성능

3,200

최대 3,200Gb/초의 RDMA 클러스터 네트워크 대역폭2

선택

VM/BM

VM을 통한 크기 조정 및 베어메탈을 통한 성능 조정

1. OCI Supercluster는 NVIDIA Blackwell B200 GPU 131,072개, NVIDIA Grace Blackwell GB200 Superchips의 NVIDIA Blackwell B200 GPU 131,072개, NVIDIA H200 Tensor Core GPU 65,536개, NVIDIA A100 Tensor Core GPU 32,768개, NVIDIA H100 Tensor Core GPU 16,384개, AMD MI300X GPU 16,384개까지 확장 가능합니다.

2. NVIDIA B200, H200, H100 GPU 및 AMD Instinct MI300X 가속기를 사용하는 베어메탈 인스턴스의 경우.

AMD Instinct MI300X GPU를 탑재한 OCI Compute용 신규 구매 전 체험판 프로그램에 등록하세요.

GPU 인스턴스-주요 기능

OCI는 NVIDIA 및 AMD GPU를 탑재한 베어메탈 인스턴스를 제공하는 유일한 주요 클라우드 제공업체로, 가상화 오버헤드가 없는 고성능 서비스를 제공합니다. AI 훈련 중 체크포인트 작업을 위해서, 당사 인스턴스는 노드당 가장 많은 로컬 스토리지(61.44TB 및 H100 GPU)를 제공합니다. 성능과 가격 간의 균형 측면에서, NVIDIA GPU를 탑재한 OCI VM은 AWS 및 Azure 대비 일관된 저렴한 가격을 제공합니다.

고성능 NVIDIA 및 AMD GPU

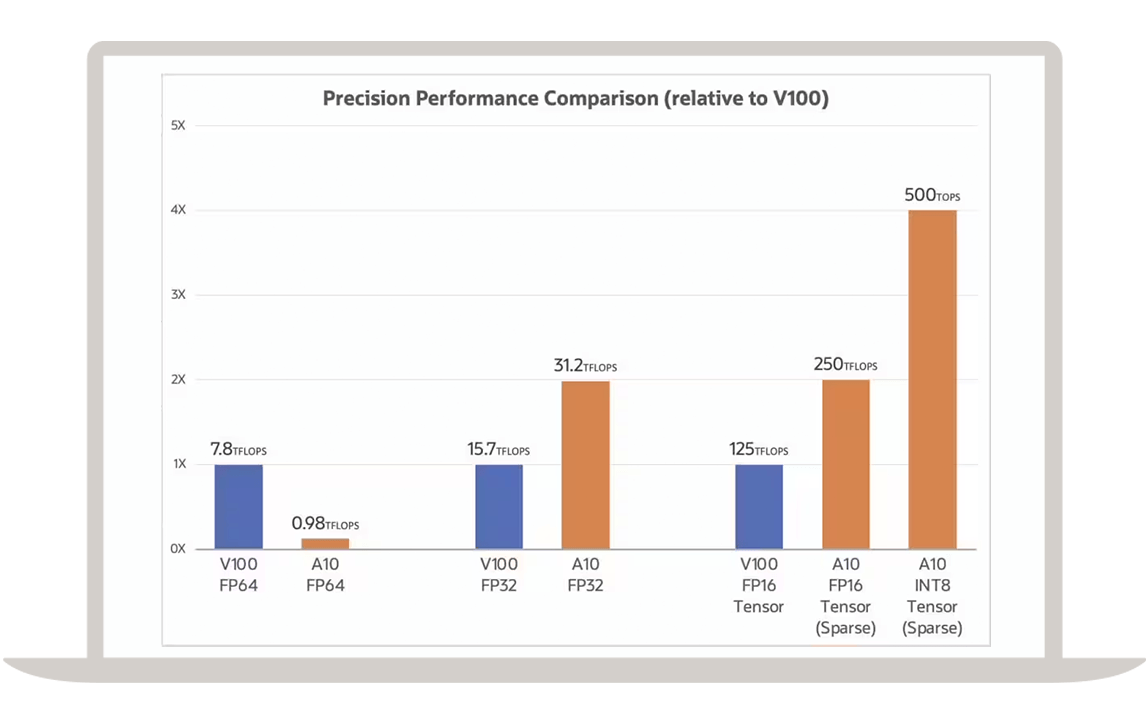

NVIDIA Tensor 코어 GPU

OCI는 다음과 같은 NVIDIA GPU들을 활용하여 베어메탈 및 가상 머신 컴퓨트 인스턴스를 위한 최고의 성능을 제공합니다: NVIDIA Blackwell GPU, H200 Tensor Core GPU, H100 Tensor Core GPU, L40S GPU, A100 Tensor Core GPU, A10 Tensor Core GPU.

NVIDIA 슈퍼칩

OCI는 100,000개 이상의 GPU로 확장되는 슈퍼클러스터에서 NVIDIA GB200 Grace Blackwell Superchip을 제공합니다.

AMD 인스턴스 가속기

OCI는 192GB의 메모리를 갖춘 AMD Instinct MI300X GPU를 GPU 시간당 $6라는 탁월한 가격에 제공합니다.

고성능 클러스터 네트워킹

Oracle의 원격 직접 메모리 액세스(RDMA) 기반 초단기 대기 시간 클러스터 네트워킹의 지연시간은 마이크로초 단위입니다.

VM, 베어메탈 인스턴스 및 Kubernetes 클러스터에 배포

VM 인스턴스

VM의 경우 1~4개 코어, VM당 16~64GB의 GPU 메모리, 최대 48Gb/초의 네트워크 대역폭을 갖춘 NVIDIA의 Hopper, Ampere 및 그 이전의 GPU 아키텍처를 선택할 수 있습니다.

베어메탈 인스턴스

AMD Instinct GPU, NVIDIA Blackwell GPU 또는 Superchips, NVIDIA Hopper GPU 또는 Superchips, NVIDIA Ampere GPU를 포함한 베어메탈 인스턴스를 갖춘 OCI Supercluster를 사용할 수 있습니다.

Kubernetes 통합관리

관리형 Kubernetes, 서비스 메시, 컨테이너 레지스트리를 활용하여 AI 및 머신러닝(ML) 교육과 컨테이너 추론을 통합관리할 수 있습니다.

즉시 사용 가능한 소프트웨어 활용

소프트웨어 및 디스크 이미지에 액세스

Oracle Cloud Marketplace에서 제공하는 데이터 과학, 분석, 인공 지능(AI), 머신러닝(ML) 모델용 소프트웨어 및 디스크 이미지를 통해 데이터로부터 인사이트를 신속히 도출할 수 있습니다.

NVIDIA AI 엔터프라이즈

생성형 AI, 컴퓨터 비전, 음성 AI 등의 데이터 과학 및 생산 AI를 위한 엔드투엔드 소프트웨어 플랫폼인 NVIDIA AI Enterprise에 액세스할 수 있습니다.

NVIDIA DGX Cloud

OCI의 NVIDIA DGX Cloud는 서비스형 AI 교육 플랫폼으로, 개발자에게 생성형 AI에 최적화된 서버리스 경험을 제공합니다.

NVIDIA GPU Cloud Machine Image

NVIDIA GPU Cloud Machine Image를 통해 광범위한 산업과 워크로드를 아우르는 머신러닝, 딥러닝, 고성능 컴퓨팅용 수백 가지 GPU 최적화 애플리케이션을 사용할 수 있습니다.

NVIDIA RTX Virtual Workstation

Oracle Cloud에서 NVIDIA RTX Virtual Workstation을 실행하여 직원들이 필요로 하는 모든 곳에서 강력한 워크스테이션 성능을 제공할 수 있습니다.

AI 컴퓨팅 환경 및 데이터 제어

분산 클라우드

OCI의 분산형 클라우드는 GPU 컴퓨팅과 결합되어 조직이 AI 및 클라우드 서비스를 필요한 곳과 방식으로 실행할 수 있도록 지원합니다.

소버린 클라우드

EU, US, UK, Australia 등 리전 또는 국가 내 데이터 레지던시를 지원합니다.

OCI Dedicated Region

OCI Dedicated Region을 통해 데이터 센터에 완전한 클라우드 리전을 배포하여 데이터 및 애플리케이션을 완벽하게 제어할 수 있습니다.

Oracle Alloy

Oracle Alloy의 파트너가 되면 특정 시장 요구 사항을 해결하기 위한 클라우드 서비스를 제공할 수 있습니다.

마이크로서비스 및 컨테이너

컨테이너 레지스트리

컨테이너를 사용하여 애플리케이션을 구축하는 개발자는 고가용성 Oracle 관리형 프라이빗 컨테이너 레지스트리 서비스를 활용하여 컨테이너 이미지를 저장하고 공유할 수 있습니다. Docker V2 API 및 표준 Docker 명령줄 인터페이스(CLI)를 사용하여 레지스트리 사이에서 Docker 이미지를 푸시하거나 풀링할 수 있습니다. 이미지를 Kubernetes 배포로 직접 풀링할 수 있습니다.

Oracle Functions

Functions as a service(FaaS)를 사용하면 개발자가 Oracle Cloud Infrastructure, Oracle Cloud Applications 및 타사 서비스와 통합되는 서버리스 애플리케이션을 실행할 수 있습니다. 또한 오픈 소스 Fn 프로젝트 커뮤니티를 통해 효율성을 개선할 수 있죠.

GPU 인스턴스-사용 사례

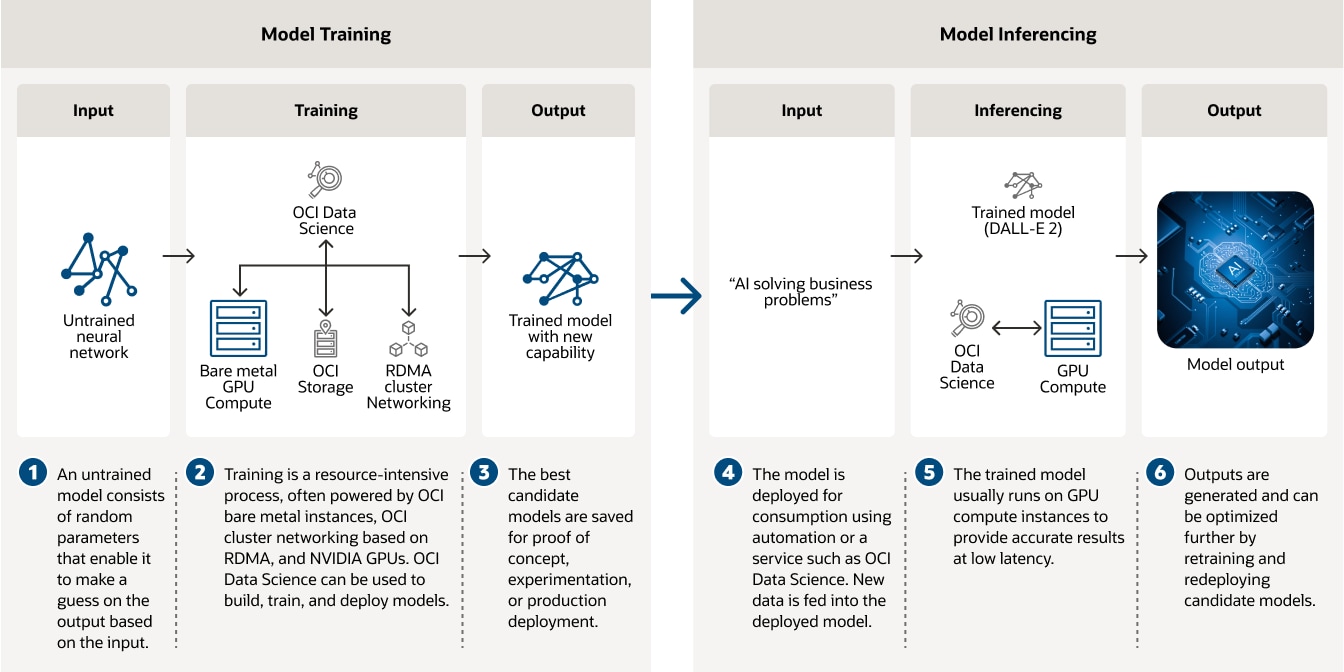

딥 러닝 학습 및 추론을 위한 AI 인프라

OCI Data Science, 베어메탈 인스턴스, RDMA 기반 클러스터 네트워킹, NVIDIA GPU 등을 사용하여 AI 모델을 학습시킬 수 있습니다.

이 다이어그램에서는 딥 러닝 모델 개발의 두 가지 단계인 '모델 훈련'과 '모델 인퍼런싱'을 설명합니다. 왼쪽의 모델 훈련에서는 훈련되지 않은 신경망 네트워크가 OCI Data Science, 베어메탈 컴퓨트, 로컬 스토리지, 클러스터 네트워킹이 지원하는 훈련 알고리즘에 입력됩니다. 새로운 기능을 활용해 훈련받은 모델이 훈련 알고리즘을 통해 출력됩니다. 모델 인퍼런싱 단계는 오른쪽에 설명되어 있습니다. 텍스트 입력을 받아 이미지를 생성할 수 있는 DALL-E 2 등 훈련된 모델을 예로 들 수 있습니다. 훈련된 모델에 텍스트 입력이 제공되면, 해당 모델이 이미지 출력을 제공합니다.

이 다이어그램에서는 딥 러닝 모델 개발의 두 가지 단계인 '모델 훈련'과 '모델 인퍼런싱'을 설명합니다. 왼쪽의 모델 훈련에서는 훈련되지 않은 신경망 네트워크가 OCI Data Science, 베어메탈 컴퓨트, 로컬 스토리지, 클러스터 네트워킹이 지원하는 훈련 알고리즘에 입력됩니다. 새로운 기능을 활용해 훈련받은 모델이 훈련 알고리즘을 통해 출력됩니다. 모델 인퍼런싱 단계는 오른쪽에 설명되어 있습니다. 텍스트 입력을 받아 이미지를 생성할 수 있는 DALL-E 2 등 훈련된 모델을 예로 들 수 있습니다. 훈련된 모델에 텍스트 입력이 제공되면, 해당 모델이 이미지 출력을 제공합니다.

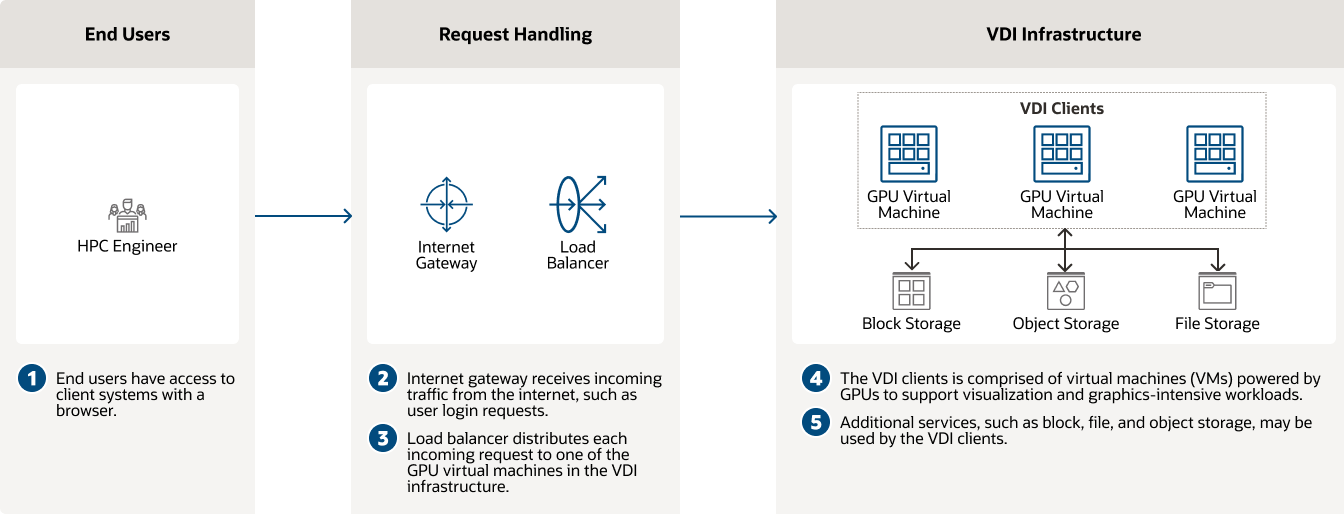

Virtual Desktop Infrastructure(VDI)

NVIDIA GPU를 활용하는 OCI Compute는 VDI를 위한 일관된 고성능을 제공합니다.

Virtual Desktop Infrastructure

Virtual Desktop Infrastructure

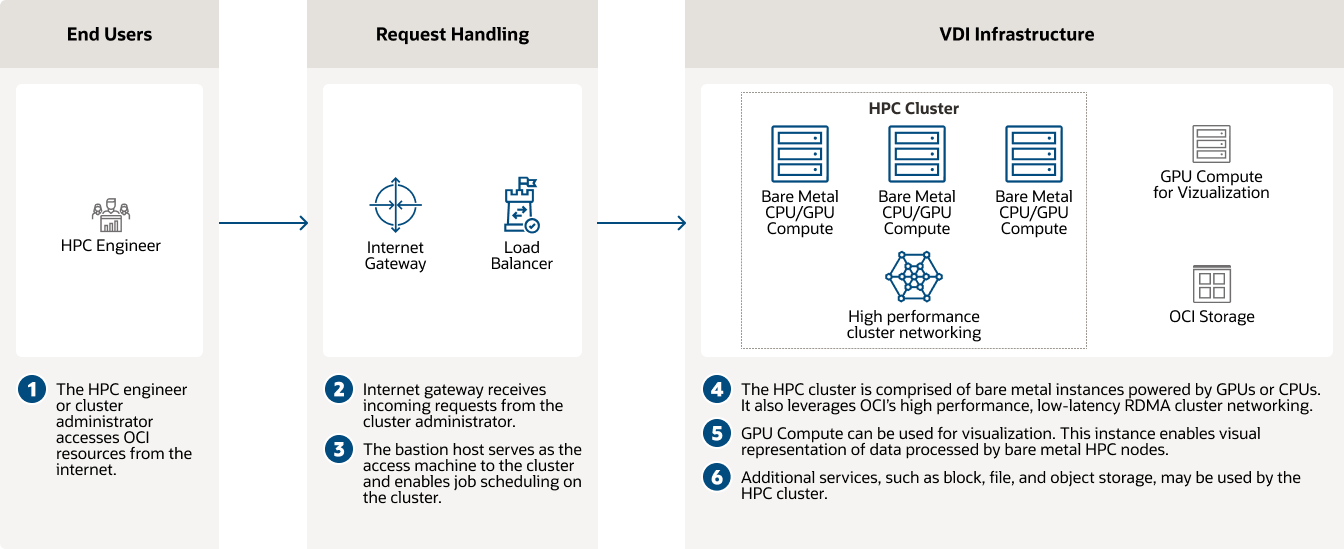

GPU 인스턴스를 사용하는 CFD 및 고성능 컴퓨팅

OCI는 컴퓨터 보조 엔지니어링 및 전산 유체 역학을 활용하여 물체의 공기역학적 특성을 빠르게 예측할 수 있도록 지원합니다.

GPU 인스턴스를 사용하는 CFD 및 고성능 컴퓨팅

GPU 인스턴스를 사용하는 CFD 및 고성능 컴퓨팅

GPU 인스턴스 시작하기

Oracle AI 30일 무료 체험하기

Oracle AI 서비스들의 가격 정책에는 대부분 무료로 이용 가능한 티어가 포함되어 있으며, 추가 클라우드 서비스를 체험할 수 있는 미화 300달러 상당의 무료 크레딧이 함께 제공됩니다. Oracle은 생성형 AI가 포함된 다양한 AI 서비스 모음을 제공합니다. 개발자들은 Oracle의 사전 구축된 머신러닝 모델을 활용하여 애플리케이션 및 비즈니스 운영에 AI를 손쉽게 적용할 수 있습니다.

-

무료 서비스 항목이 포함된 Oracle AI 및 ML 서비스

- OCI Speech

- OCI Language

- OCI Vision

- OCI Document Understanding

- Oracle Database에 포함된 Machine Learning

- OCI Data Labeling

또한 OCI Data Science를 사용하면서 발생한 컴퓨트 및 스토리지 비용만이 청구됩니다.

-

GPU 인스턴스로 무엇을 할 수 있습니까?

- NVIDIA와 AMD의 GPU를 갖춘 호스트 LLM

- NVIDIA GPU로 분산형 다중 노드 훈련 실행

- LLM 및 검색 증강 생성을 통한 작업 자동화

- NVIDIA NIM 추론 규모 확장

OCI를 통해 얻을 수 있는 절감 효과 확인하기

Oracle Cloud는 저렴한 가격을 전 세계적으로 동일하게 적용하며, 간편하고 다양한 사용 사례를 지원합니다. 예상 요금 절감액을 확인하려면, 비용 계산기를 사용하여 필요에 맞게 서비스를 구성해보세요.

차이를 경험해보세요

- 1/4의 아웃바운드 대역폭 비용

- 가격 대비 컴퓨트 성능 3배

- 모든 리전에 동일하게 적용되는 저렴한 가격

- 장기 약정 없는 저렴한 가격 정책

GPU 및 AI 전문가와 상담하기

Oracle 전문가들이 GPU 솔루션 구축, OCI AI 인프라에 워크로드 배포하기와 같은 다양한 AI 관련 주제에 대한 상담을 제공합니다.

-

다음과 같은 문의사항들에 답해드립니다.

- Oracle Cloud를 시작하려면 어떻게 해야 하나요?

- OCI에서는 어떤 종류의 AI 워크로드를 실행할 수 있나요?

- OCI는 어떤 유형의 AI 서비스를 제공하나요?