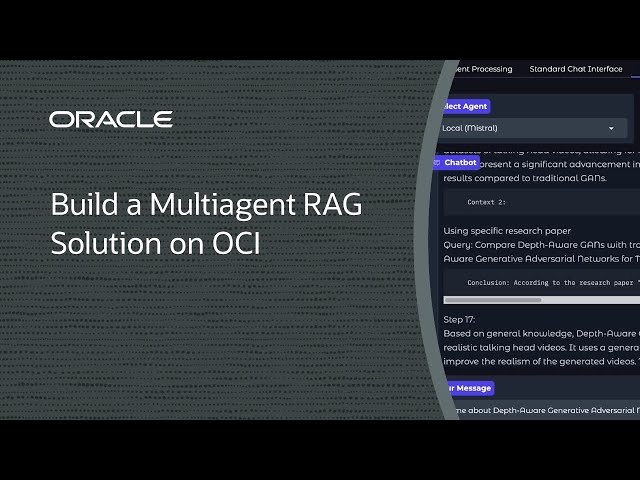

Créer une solution RAG multiagent sur OCI

Introduction

La génération augmentée de récupération (RAG) peut se révéler utile pour les requêtes simples. Mais qu'en est-il des requêtes complexes, nécessitant un raisonnement en plusieurs étapes et une prise de décision ? Par exemple, il serait utile qu'un chatbot de support puisse résoudre des problèmes et pas seulement régurgiter les FAQ.

Dans cette solution, nous allons configurer un pipeline RAG multiagent et le déployer sur Oracle Cloud Infrastructure (OCI) avec Oracle AI Database pour répondre intelligemment à une requête. Les agents du grand modèle de langage (LLM) planifient, recherchent et motivent la réponse de l'IA ; ce processus de chaîne de pensée (CoT) imite la manière dont nous résolvons les problèmes. Une interface Gradio orchestre le traitement des données : plusieurs sources de données sont téléchargées, ingérées et stockées en tant que vecteurs à l'aide d'outils open source. Gradio fournit également l'interface de discussion pour saisir une requête en langage naturel.

Avec la visualisation CoT dans Gradio, vous verrez les étapes et les décisions prises par chaque agent pour fournir la réponse finale et synthétisée. Cette solution fournit un exemple facile à suivre de la façon dont l'IA agentique peut améliorer les capacités de raisonnement des modèles locaux et basés sur le cloud.

Démonstration

Prérequis et configuration

- Compte Oracle Cloud : page d'inscription

- OCI Generative AI : documentation

- OCI Generative AI Agents : documentation

- Oracle AI Database : documentation

- Docling : documentation

- Gradio : documentation

- Trafilatura : documentation